ラフ画へ自動的にペン入れして線画にする恐るべきニューラルネットワーク技術を早稲田大学の研究室が開発 (original) (raw)

2016年04月28日 13時00分 ソフトウェア

ラフ画へ自動的にペン入れして線画にする恐るべきニューラルネットワーク技術を早稲田大学の研究室が開発

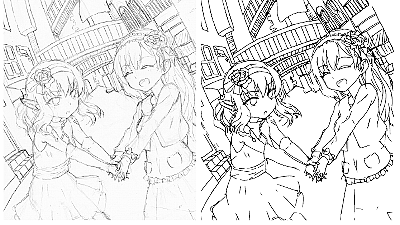

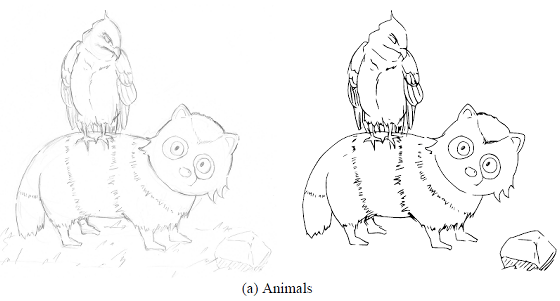

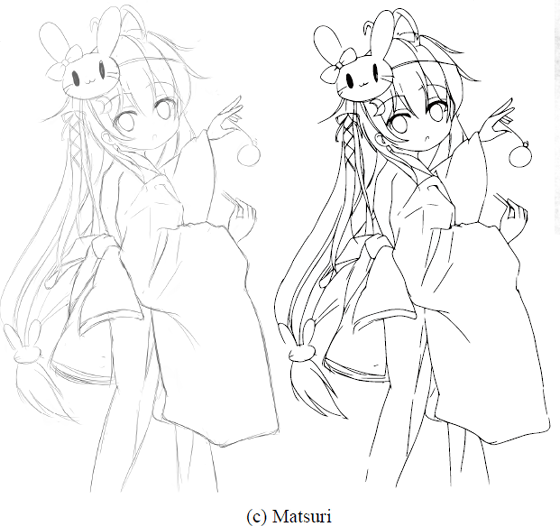

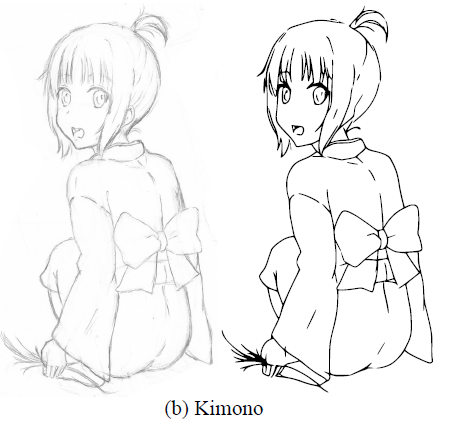

早稲田大学の**シモセラ・エドガー**研究院助教らが開発したのは、鉛筆で描いたラフ画を一発で自動的に線画にしてくれる技術。例えば以下の画像でいうと、左側がラフ画スケッチ、右側がニューラルネットワークモデルで線画化したものです。

着物の女の子や……

お祭りっぽい雰囲気の女の子。

かなり線が重なっているように見えるお面のスケッチもこの通り。

複雑なスケッチでもかなりの精度で線画化しているのがわかります。

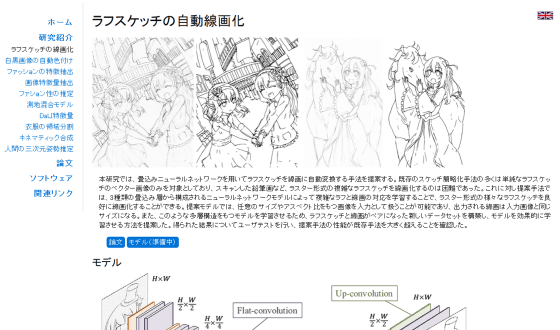

これまで、スキャンした鉛筆画など複雑なラフスケッチの線画化は非常に困難でした。しかし、新しい手法では3種類の畳込み層から構成されるニューラルネットワークモデル(畳み込みニューラルネットワーク)によって複雑なラフと線画の対応を学習させることで、技術を可能にしたとのこと。この手法では入力する画像のサイズを問わず、出力される線画は入力画像と同じサイズになるそうです。

モデルは「down-convolution」「flat-convolution」「up-convolution」の3種類の畳込み層から構成されていて、「down-convolutionではフィルタのストライド数を2にすることでマップの解像度を半分にし、flat-convolutionではマップの解像度は変えず、up-convolutionではストライド数を1/2にしてマップの解像度を2倍にしている。これにより、最初は画像を小さな特徴マップに圧縮して処理していき、最後に元の解像度に戻してきれいな線画を出力することができる」とのことです。

なお、ラフスケッチ、**Potrace、Adobe Illustrator**のライブトレース機能、早稲田大学研究室の新技術の4つを比較するとこんな感じ。左から2番目のPotraceは余分な線が残りすぎており、左から3番目Adobeのライブトレース機能は線が単純化されすぎたり、消えてしまったりしています。一方で、1番右にあるニューラルネットワークを利用した新技術は、線の取捨選択ができていて、手でペン入れをしたかのような印象を持ちます。

ディープネットワークを用いて、入力した白黒画像を自動的にカラー画像として出力してくれる技術で、自動線画化の技術と同じく畳折りネットワークを使うことで、画像全体の構造を考慮した自然な色づけが行えるとのこと。仕組みとしては、まず人工知能を用いて写真全体の特徴を抽出し、要素ごとにフィルタリングして適切な色づけを行うというもの。

1930年代に撮影されたモノクロ写真が、まるで最近に撮られたかのような鮮やかなカラー写真に変換されていることがわかります。

そのほかの作例は以下のような感じ。

なお、モノクロ写真をカラー写真として自動色づけする技術のソースコードはGitHub上で無料公開中です。

GitHub - satoshiiizuka/siggraph2016_colorization: Code for the paper 'Let there be Color!: Joint End-to-end Learning of Global and Local Image Priors for Automatic Image Colorization with Simultaneous Classification'.

https://github.com/satoshiiizuka/siggraph2016_colorization

- << 次の記事

ポケモンを現実世界でプレイする「ポケモンGO(Pokémon GO)」ベータテストのプレイムービーが登場 - 前の記事 >>

Microsoftが1グラムのDNAに10億テラバイト=1ゼタバイトものデータを保存する「DNAメモリ」技術に出資

2016年04月28日 13時00分00秒 in ソフトウェア, ネットサービス, Posted by darkhorse_log

You can read the machine translated English article here.